12주차-5월 23일

빅데이터분석특강

import tensorflow as tf

import tensorflow.experimental.numpy as tnp

tnp.experimental_enable_numpy_behavior()

import matplotlib.pyplot as plt

import numpy as np

%load_ext tensorboard

- 데이터생성 (그냥 흑백대비 데이터)

_X1 = tnp.ones([50,25])*10

_X1

_X2 = tnp.zeros([50,25])*10

_X2

tf.concat([_X1,_X2],axis=1)

_noise = tnp.random.randn(50*50).reshape(50,50)

_noise

XXX = tf.concat([_X1,_X2],axis=1) + _noise

XXX=XXX.reshape(1,50,50,1)

plt.imshow(XXX.reshape(50,50),cmap='gray')

- conv layer 생성

conv = tf.keras.layers.Conv2D(2,(2,2))

conv.weights # 처음에는 가중치가 없음

conv(XXX) # 가중치를 만들기 위해서 XXX를 conv에 한번 통과시킴

conv.weights # 이제 가중치가 생김

- 가중치의 값을 확인해보자.

conv.weights[0] # kernel에 해당하는것

conv.weights[1] # bias에 해당하는것

- 필터값을 원하는 것으로 변경해보자.

w0 = [[0.25,0.25],[0.25,0.25]] # 잡티를 제거하는 효과를 준다.

w1 = [[-1.0,1.0],[-1.0,1.0]] # 경계를 찾기 좋아보이는 필터이다. (엣지검출)

w=np.concatenate([np.array(w0).reshape(2,2,1,1),np.array(w1).reshape(2,2,1,1)],axis=-1)

w

b= np.array([0.0,0.0])

b

conv.set_weights([w,b])

conv.get_weights()

- 첫번째는 평균을 구하는 필터,

- 두번째는 엣지를 검출하는 필터

- 필터를 넣은 결과를 확인

XXX0=conv(XXX)[...,0] # 채널0

XXX0

XXX1=conv(XXX)[...,1] # 채널1

XXX1

- 각 채널을 시각화

fig, ((ax1,ax2),(ax3,ax4)) = plt.subplots(2,2)

ax1.imshow(XXX.reshape(50,50),cmap='gray')

ax3.imshow(XXX0.reshape(49,49),cmap='gray')

ax4.imshow(XXX1.reshape(49,49),cmap='gray')

fig

- 2사분면: 원래이미지

- 3사분면: 원래이미지 -> 평균을 의미하는 conv적용

- 4사분면: 원래이미지 -> 엣지를 검출하는 conv적용

- conv(XXX)의 각 채널에 한번더 conv를 통과시켜보자

conv(XXX0.reshape(1,49,49,1))[...,0] ### XXX0 -> 평균필터 <=> XXX -> 평균필터 -> 평균필터

conv(XXX0.reshape(1,49,49,1))[...,1] ### XXX0 -> 엣지필터 <=> XXX -> 평균필터 -> 엣지필터

conv(XXX1.reshape(1,49,49,1))[...,0] ### XXX1 -> 평균필터 <=> XXX -> 엣지필터 -> 평균필터

conv(XXX1.reshape(1,49,49,1))[...,1] ### XXX1 -> 엣지필터 <=> XXX -> 엣지필터 -> 엣지필터

fig,ax =plt.subplots(3,4)

ax[0][0].imshow(XXX.reshape(50,50),cmap='gray') # 원래이미지

ax[1][0].imshow(XXX0.reshape(49,49),cmap='gray') # 원래이미지 -> 평균필터

ax[1][2].imshow(XXX1.reshape(49,49),cmap='gray') # 원래이미지 -> 엣지필터

ax[2][0].imshow(conv(XXX0.reshape(1,49,49,1))[...,0].reshape(48,48),cmap='gray') # 원래이미지 -> 평균필터

ax[2][1].imshow(conv(XXX0.reshape(1,49,49,1))[...,1].reshape(48,48),cmap='gray') # 원래이미지 -> 엣지필터

ax[2][2].imshow(conv(XXX1.reshape(1,49,49,1))[...,0].reshape(48,48),cmap='gray') # 원래이미지 -> 평균필터

ax[2][3].imshow(conv(XXX1.reshape(1,49,49,1))[...,1].reshape(48,48),cmap='gray') # 원래이미지 -> 엣지필터

fig.set_figheight(8)

fig.set_figwidth(16)

fig.tight_layout()

fig

- 요약

- conv의 weight에 따라서 엣지를 검출하는 필터가 만들어지기도 하고 스무딩의 역할을 하는 필터가 만들어지기도 한다. 그리고 우리는 의미를 알 수 없지만 어떠한 역할을 하는 필터가 만들어질 것이다.

- 이것들을 조합하다보면 우연히 이미지를 분류하기에 유리한 특징을 뽑아내는 weight가 맞춰질 수도 있겠다.

- 채널수를 많이 만들고 다양한 웨이트조합을 실험하다보면 보다 복잡한 이미지의 특징을 추출할 수도 있을 것이다?

- 컨볼루션 레이어의 역할 = 이미지의 특징을 추출하는 역할

- 참고: 스트라이드, 패딩

- 스트라이드: 윈도우가 1칸씩 이동하는 것이 아니라 2~3칸씩 이동함

- 패딩: 이미지의 가장자리에 정당한 값을 넣어서 (예를들어 0) 컨볼루션을 수행. 따라서 컨볼루션 연산 이후에도 이미지의 크기가 줄어들지 않도록 방지한다.

- 기본적역할: 이미지의 크기를 줄이는 것

- 이미지의의 크기를 줄여야하는 이유? 어차피 최종적으로 10차원으로 줄어야하므로

- 이미지의 크기를 줄이면서도 동시에 아주 크리티컬한 특징은 손실없이 유지하고 싶다~

- 점점 작은 이미지가 되면서 중요한 특징들은 살아남지만 그렇지 않으면 죽는다. (캐리커쳐 느낌)

- 평균이 아니라 max를 쓴 이유는? 그냥 평균보다 나을것이라고 생각했음..

- 그런데 사실은 꼭 그렇지만은 않아서 최근에는 꼭 맥스풀링을 고집하진 않는 추세 (평균풀링도 많이씀)

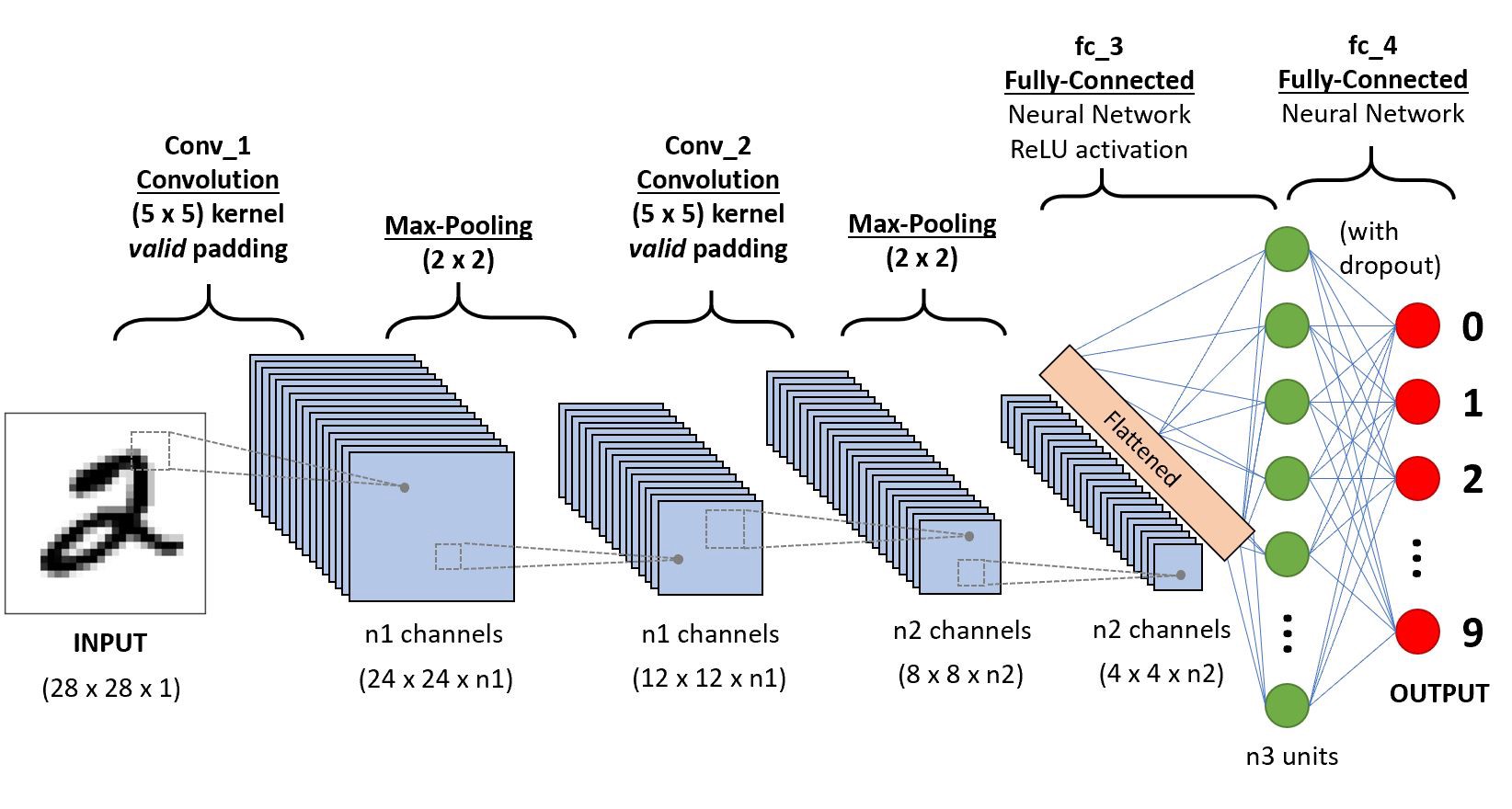

- 아래와 같이 아키텍처의 다이어그램형태로 표현하고 굳이 노드별로 이미지를 그리진 않음

- 물론 아래와 같이 그리는 경우도 있음

- 격자형태로 배열된 자료를 처리하는데 특화된 신경망이다.

- 시계열 (1차원격자), 이미지 (2차원격자)

- 실제응용에서 엄청난 성공을 거두었다.

- 이름의 유래는 컨볼루션이라는 수학적 연산을 사용했기 때문

- 컨볼루션은 조금 특별한 선형변환이다.

- 신경과학의 원리가 심층학습에 영향을 미친 사례이다.

- 희소성 + 매개변수의 공유

- 다소 철학적인 모티브임

- 희소성: 이미지를 분석하여 특징을 뽑아낼때 부분부분의 특징만 뽑으면 된다는 의미

- 매개변수의 공유: 한 채널에는 하나의 역할을 하는 커널을 설계하면 된다는 의미 (스무딩이든 엣징이든). 즉 어떤지역은 스무딩, 어떤지역은 엣징을 할 필요가 없이 한채널에서는 엣징만, 다른채널에서는 스무딩만 수행한뒤 여러채널을 조합해서 이해하면 된다.

- 매개변수 공유효과로 인해서 파라메터가 확 줄어든다.

(예시) (1,6,6,1) -> (1,5,5,2)

- MLP방식이면 (36,50) 의 차원을 가진 매트릭스가 필요함 => 1800개의 매개변수 필요

- CNN은 8개의 매개변수 필요

- 기본유닛

- conv - activation - pooling

- conv - conv - activation - pooling

- 아래의 예제를 복습하자.

np.random.seed(43052)

x = np.linspace(0,1,100).reshape(100,1)

y = np.random.normal(loc=0,scale=0.01,size=(100,1))

plt.plot(x,y)

tf.random.set_seed(43052)

net = tf.keras.Sequential()

net.add(tf.keras.layers.Dense(2048,activation='relu'))

net.add(tf.keras.layers.Dense(1))

net.compile(loss='mse',optimizer='adam')

net.fit(x,y,epochs=5000,verbose=0,batch_size=100)

plt.plot(x,y)

plt.plot(x,net(x),'--')

- train/test로 나누어서 생각해보자.

tf.random.set_seed(43052)

net = tf.keras.Sequential()

net.add(tf.keras.layers.Dense(2048,activation='relu'))

net.add(tf.keras.layers.Dense(1))

net.compile(loss='mse',optimizer='adam')

net.fit(x[:80],y[:80],epochs=5000,verbose=0,batch_size=80)

plt.plot(x,y)

plt.plot(x[:80],net(x[:80]),'--')

plt.plot(x,y)

plt.plot(x[:80],net(x[:80]),'--')

plt.plot(x[80:],net(x[80:]),'--')

- train에서 추세를 따라가는게 좋은게 아니다 $\to$ 그냥 직선으로 핏하는거 이외에는 다 오버핏이다.

- 매 에폭마다 적당히 80%의 노드들을 빼고 학습하자 $\to$ 너무 잘 학습되는 문제는 생기지 않을 것이다 (과적합이 방지될것이다?)

tf.random.set_seed(43052)

net = tf.keras.Sequential()

net.add(tf.keras.layers.Dense(2048,activation='relu'))

net.add(tf.keras.layers.Dropout(0.8))

net.add(tf.keras.layers.Dense(1))

net.compile(loss='mse',optimizer='adam')

net.fit(x[:80],y[:80],epochs=5000,verbose=0,batch_size=80)

plt.plot(x,y)

plt.plot(x[:80],net(x[:80]),'--')

plt.plot(x[80:],net(x[80:]),'--')

- 드랍아웃에 대한 summary

- 직관: 특정노드를 랜덤으로 off시키면 학습이 방해되어 오히려 과적합이 방지되는 효과가 있다 (그렇지만 진짜 중요한 특징이라면 랜덤으로 off 되더라도 어느정도는 학습될 듯)

- note: 드랍아웃을 쓰면 오버핏이 줄어드는건 맞지만 완전히 없어지는건 아니다.

- note: 오버핏을 줄이는 유일한 방법이 드랍아웃만 있는것도 아니며, 드랍아웃이 오버핏을 줄이는 가장 효과적인 방법도 아니다 (최근에는 dropout보다 batch nomalization을 사용하는 추세임)

- data

(x_train, y_train), (x_test, y_test) = tf.keras.datasets.fashion_mnist.load_data()

X= x_train.reshape(-1,28,28,1)/255 ## 입력이 0~255 -> 0~1로 표준화 시키는 효과 + float으로 자료형이 바뀜

y = tf.keras.utils.to_categorical(y_train)

XX = x_test.reshape(-1,28,28,1)/255

yy = tf.keras.utils.to_categorical(y_test)

net = tf.keras.Sequential()

net.add(tf.keras.layers.Flatten())

net.add(tf.keras.layers.Dense(50,activation='relu'))

net.add(tf.keras.layers.Dense(10,activation='softmax'))

net.compile(optimizer='adam',loss=tf.losses.categorical_crossentropy,metrics='accuracy')

cb1 = tf.keras.callbacks.TensorBoard()

net.fit(X,y,epochs=20,batch_size=200,validation_split=0.2,callbacks=cb1,verbose=1)

- 텐서보드 여는 방법1

%load_ext tensorboard

# 주피터노트북 (혹은 주피터랩)에서 텐서보드를 임베딩하여 넣을 수 있도록 도와주는 매직펑션

#!kill 313799

%tensorboard --logdir logs --host 0.0.0.0

# %tensorboard --logdir logs <-- 실습에서는 이렇게 하면됩니다.

(참고사항) 파이썬 3.10의 경우 아래의 수정이 필요

?/python3.10/site-packages/tensorboard/_vendor/html5lib/_trie/_base.py 을 열고

from collections import Mapping ### 수정전

from collections.abc import Mapping ### 수정후

와 같이 수정한다.

- 왜냐하면 파이썬 3.10부터

from collections import Mapping가 동작하지 않고from collections.abc import Mapping가 동작하도록 문법이 바뀜

- 텐서보드를 실행하는 방법2

# !tensorboard --logdir logs --host 0.0.0.0

# !tensorboard --logdir logs <-- 실습에서는 이렇게 하면됩니다.

- 텐서보드를 살펴보니 특정에폭 이후에는 오히려 과적합이 진행되는 듯 하다 (학습할수록 손해인듯 하다) $\to$ 그 특정에폭까지만 학습해보자

tf.random.set_seed(43052)

net = tf.keras.Sequential()

net.add(tf.keras.layers.Flatten())

net.add(tf.keras.layers.Dense(5000,activation='relu')) ## 과적합좀 시키려고

net.add(tf.keras.layers.Dense(5000,activation='relu')) ## 레이어를 2장만듬 + 레이어하나당 노드수도 증가

net.add(tf.keras.layers.Dense(10,activation='softmax'))

net.compile(optimizer='adam',loss=tf.losses.categorical_crossentropy,metrics='accuracy')

#cb1 = tf.keras.callbacks.TensorBoard()

cb2 = tf.keras.callbacks.EarlyStopping(patience=1) # val-loss가 1회증가하면 멈추어라

net.fit(X,y,epochs=200,batch_size=200,validation_split=0.2,callbacks=cb2,verbose=1)

#cb1 = tf.keras.callbacks.TensorBoard()

cb2 = tf.keras.callbacks.EarlyStopping(patience=1) # val-loss가 1회증가하면 멈추어라

net.fit(X,y,epochs=200,batch_size=200,validation_split=0.2,callbacks=cb2,verbose=1)

#cb1 = tf.keras.callbacks.TensorBoard()

cb2 = tf.keras.callbacks.EarlyStopping(patience=1) # val-loss가 1회증가하면 멈추어라

net.fit(X,y,epochs=200,batch_size=200,validation_split=0.2,callbacks=cb2,verbose=1)

#cb1 = tf.keras.callbacks.TensorBoard()

cb2 = tf.keras.callbacks.EarlyStopping(patience=1) # val-loss가 1회증가하면 멈추어라

net.fit(X,y,epochs=200,batch_size=200,validation_split=0.2,callbacks=cb2,verbose=1)

#cb1 = tf.keras.callbacks.TensorBoard()

cb2 = tf.keras.callbacks.EarlyStopping(patience=1) # val-loss가 1회증가하면 멈추어라

net.fit(X,y,epochs=200,batch_size=200,validation_split=0.2,callbacks=cb2,verbose=1)

#cb1 = tf.keras.callbacks.TensorBoard()

cb2 = tf.keras.callbacks.EarlyStopping(patience=1) # val-loss가 1회증가하면 멈추어라

net.fit(X,y,epochs=200,batch_size=200,validation_split=0.2,callbacks=cb2,verbose=1)

- 몇 번 좀 참았다가 멈추면 좋겠다.

tf.random.set_seed(43052)

net = tf.keras.Sequential()

net.add(tf.keras.layers.Flatten())

net.add(tf.keras.layers.Dense(5000,activation='relu')) ## 과적합좀 시키려고

net.add(tf.keras.layers.Dense(5000,activation='relu')) ## 레이어를 2장만듬 + 레이어하나당 노드수도 증가

net.add(tf.keras.layers.Dense(10,activation='softmax'))

net.compile(optimizer='adam',loss=tf.losses.categorical_crossentropy,metrics='accuracy')

#cb1 = tf.keras.callbacks.TensorBoard()

cb2 = tf.keras.callbacks.EarlyStopping(patience=5) # 좀더 참다가 멈추어라

net.fit(X,y,epochs=200,batch_size=200,validation_split=0.2,callbacks=cb2,verbose=1)

- 텐서보드로 그려보자?

# %tensorboard --logdir logs --host 0.0.0.0

# 아무것도 안나온다 -> 왜? cb1을 써야 텐서보드가 나옴

- 조기종료와 텐서보드를 같이 쓰려면?

tf.random.set_seed(43052)

net = tf.keras.Sequential()

net.add(tf.keras.layers.Flatten())

net.add(tf.keras.layers.Dense(50,activation='relu'))

net.add(tf.keras.layers.Dense(10,activation='softmax'))

net.compile(optimizer='adam',loss=tf.losses.categorical_crossentropy,metrics='accuracy')

cb1 = tf.keras.callbacks.TensorBoard()

cb2 = tf.keras.callbacks.EarlyStopping(patience=7) # 좀더 참다가 멈추어라

net.fit(X,y,epochs=200,batch_size=200,validation_split=0.2,callbacks=[cb1,cb2])

# 조기종료가 구현된 그림이 출력

# %tensorboard --logdir logs --host 0.0.0.0

- 하이퍼파라메터 설정

from tensorboard.plugins.hparams import api as hp

a=net.evaluate(XX,yy)

!rm -rf logs

for u in [50,5000]:

for d in [0.0,0.5]:

for o in ['adam','sgd']:

logdir = 'logs/hpguebin_{}_{}_{}'.format(u,d,o)

with tf.summary.create_file_writer(logdir).as_default():

net = tf.keras.Sequential()

net.add(tf.keras.layers.Flatten())

net.add(tf.keras.layers.Dense(u,activation='relu'))

net.add(tf.keras.layers.Dropout(d))

net.add(tf.keras.layers.Dense(10,activation='softmax'))

net.compile(optimizer=o,loss=tf.losses.categorical_crossentropy,metrics=['accuracy','Recall'])

cb3 = hp.KerasCallback(logdir, {'유닛수':u, '드랍아웃비율':d, '옵티마이저':o})

net.fit(X,y,epochs=3,callbacks=cb3)

_rslt=net.evaluate(XX,yy)

_mymetric=_rslt[1]*0.8 + _rslt[2]*0.2

tf.summary.scalar('애큐러시와리컬의가중평균(테스트셋)', _mymetric, step=1)

#%tensorboard --logdir logs --host 0.0.0.0

- 아래의 네트워크에서 옵티마이저를 adam, sgd를 선택하여 각각 적합시켜보고 testset의 loss를 성능비교를 하라. epoch은 5정도로 설정하라.

net = tf.keras.Sequential()

net.add(tf.keras.layers.Flatten())

net.add(tf.keras.layers.Dense(50,activation='relu'))

net.add(tf.keras.layers.Dense(50,activation='relu'))

net.add(tf.keras.layers.Dense(10,activation='softmax'))

net.compile(optimizer=???,loss=tf.losses.categorical_crossentropy,metrics=['accuracy','Recall'])!rm -rf logs

tf.random.set_seed(202150754)

net1 = tf.keras.Sequential()

net1.add(tf.keras.layers.Flatten())

net1.add(tf.keras.layers.Dense(50,activation='relu'))

net1.add(tf.keras.layers.Dense(50,activation='relu'))

net1.add(tf.keras.layers.Dense(10,activation='softmax'))

net1.compile(optimizer='adam',loss=tf.losses.categorical_crossentropy,metrics=['accuracy','Recall'])

cb1 = tf.keras.callbacks.TensorBoard()

cb2 = tf.keras.callbacks.EarlyStopping(patience=7)

net1.fit(X,y,epochs=5,batch_size=200,validation_split=0.2,callbacks=[cb1,cb2])

%tensorboard --logdir logs --host 0.0.0.0

- sgd 적합

!rm -rf logs

tf.random.set_seed(202150754)

net2 = tf.keras.Sequential()

net2.add(tf.keras.layers.Flatten())

net2.add(tf.keras.layers.Dense(50,activation='relu'))

net2.add(tf.keras.layers.Dense(50,activation='relu'))

net2.add(tf.keras.layers.Dense(10,activation='softmax'))

net2.compile(optimizer='sgd',loss=tf.losses.categorical_crossentropy,metrics=['accuracy','Recall'])

net2.fit(X,y,epochs=5,batch_size=200,validation_split=0.2,callbacks=[cb1,cb2])

%tensorboard --logdir logs --host 0.0.0.0

net1.evaluate(XX,yy)[0]

net2.evaluate(XX,yy)[0]

adam을 선택했을떄 loss는 0.41707104444503784 이고,

sgd을 선택했을때 loss는 0.6277241706848145 이다.

loss 값을 보면 sgd보다 adam 값이 더 낮다.